Anthropic thông báo người dùng Claude phải chọn chia sẻ dữ liệu để huấn luyện AI hoặc từ chối trước ngày 28/09/2025.

Anthropic, công ty đứng sau Claude AI, đang thực hiện thay đổi lớn về cách xử lý dữ liệu người dùng. Bắt đầu từ ngày 28/08/2029, người dùng Claude sẽ được yêu cầu lựa chọn cho phép Anthropic sử dụng các cuộc trò chuyện để huấn luyện các mô hình AI tương lai hoặc từ chối và giữ dữ liệu riêng tư. Nếu không đưa ra lựa chọn trước ngày 28/09/2025, người dùng sẽ hoàn toàn mất quyền truy cập Claude.

Trước đây, Anthropic áp dụng phương châm bảo mật ưu tiên, có nghĩa là các cuộc trò chuyện và mã code của người dùng sẽ tự động bị xóa sau 30 ngày trừ khi cần thiết vì lý do pháp lý. Tuy nhiên, từ ngày 28/09/2025, trừ khi người dùng từ chối, dữ liệu sẽ được lưu trữ tới năm năm và đưa vào các chu kỳ huấn luyện để giúp Claude trở nên thông minh hơn.

Chính sách mới áp dụng cho tất cả các gói bao gồm Free, Pro và Max, cũng như Claude Code thuộc các cấp này. Người dùng doanh nghiệp, chính phủ, giáo dục và API sẽ không bị ảnh hưởng.

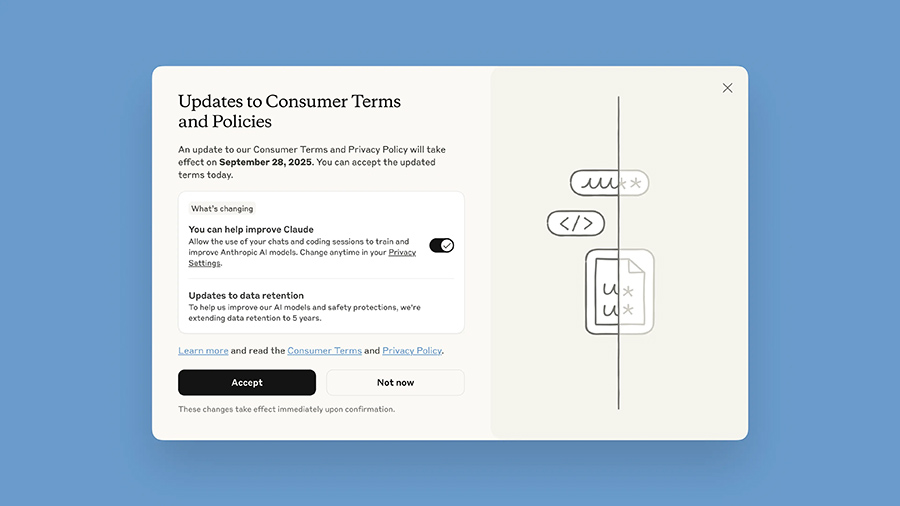

Người dùng mới sẽ thấy lựa chọn này trong quá trình đăng ký. Người dùng hiện tại sẽ nhận được cửa sổ bật lên có tên “Updates to Consumer Terms and Policies”. Nếu chọn nút Accept (Chấp nhận) là bạn đồng ý chia sẻ dữ liệu, trong khi Not now (Không phải bây giờ) cho phép bạn từ chối.

Nếu bỏ qua thông báo này, tài khoản Claude của bạn sẽ ngừng hoạt động sau ngày 28/09/2025.

Điều quan trọng cần lưu ý là chỉ những cuộc trò chuyện và mã trong tương lai mới bị ảnh hưởng. Mọi thứ người dùng đã trò chuyện trước đây sẽ không được sử dụng trừ khi mở lại những cuộc trò chuyện đó. Nếu xóa một cuộc trò chuyện, nó sẽ không được dùng để huấn luyện.

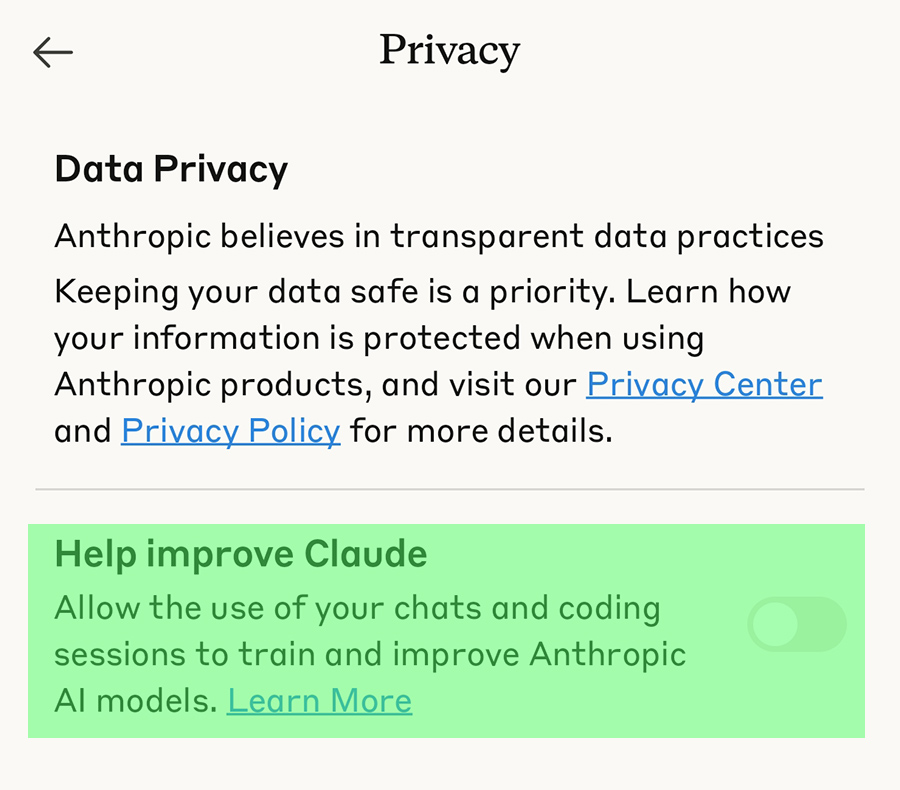

Người dùng có thể thay đổi quyết định sau này trong Privacy Settings, nhưng một khi dữ liệu đã được sử dụng để huấn luyện, nó không thể được thu hồi.

Anthropic cho biết dữ liệu người dùng là chìa khóa để làm cho Claude tốt hơn trong việc hiểu ngữ cảnh, lập trình, lý luận và duy trì an toàn. Công ty này cũng nhấn mạnh rằng họ không bán dữ liệu cho bên thứ ba và sử dụng bộ lọc tự động để loại bỏ thông tin nhạy cảm trước khi huấn luyện.

Tuy nhiên, chính sách mới này chuyển từ bảo mật tự động sang chia sẻ dữ liệu tự động trừ khi người dùng nói không. Quyết định của Anthropic về cơ bản đặt Claude trên con đường cải thiện nhanh hơn dựa trên dữ liệu thực tế mà nó được huấn luyện.

Đối với đa số người dùng, điều này có thể không quan trọng. Nhưng đối với những người quan tâm đến quyền riêng tư, hoặc bất kỳ ai thảo luận về công việc, vấn đề cá nhân hoặc thông tin nhạy cảm trong Claude, bản cập nhật này có thể là một dấu hiệu cảnh báo.